Jak sprawdzić i poprawić AI crawlability? Analiza eksperta

• Czym jest AI crawlability i czym różni się od tradycyjnego SEO?

• Jak działają crawlery AI?

• Jakie boty AI odwiedzają Twoją stronę?

• Crawlability a boty OpenAI

• Anthropic - ClaudeBot i pochodne

• Jakie boty Perplexity wchodzą na Twoją stronę?

• Google-Extended

• Pozostałe crawlery ważne w AI search

• Co blokuje crawlery AI?

• Jak kontrolować dostęp crawlerów AI do Twojej strony?

• Dwa typy botów AI - dwie różne strategie

• Przykładowa konfiguracja robots.txt

• Ograniczenia robots.txt a boty AI

• Dane Schema - jak wpływają na widoczność dla botów AI?

• Które znaczniki Schema są najważniejsze?

• Jak zweryfikować poprawność znaczników Schema?

• Czym jest llms.txt i czy naprawdę go potrzebujesz?

• Core Web Vitals i wydajność strony w kontekście AI crawlability

• Czy boty AI mogą wejść na Twoją stronę?

• Jak poprawić widoczność strony dla botów AI? Checklista

• Podsumowanie

• FAQ

Chcesz sprawić, że Twoja marka będzie pojawiać się w odpowiedziach ChatGPT, Perplexity czy Google AI Overviews? W pierwszej kolejności zadbaj o to, aby crawler danej platformy mógł znaleźć i zrozumieć jej zawartość. AI crawlability to jeden z podstawowych warunków SEO AI - niezależnie od tego, jak dobrą treść przygotowałeś. Przeczytaj nasz artykuł i dowiedz się, jak sprawdzić, czy boty AI mogą wejść na Twoją stronę oraz jak możesz im to umożliwić.

Z tego artykułu dowiesz się:

- Czemu ważne jest, aby boty AI mogły odnaleźć i zrozumieć Twoją stronę?

- Jak sprawdzić, czy Twoja witryna jest przyjazna dla crawlerów AI?

- Czym różnią się boty treningowe od botów cytujących?

- Jak skonfigurować plik robots.txt pod kątem najważniejszych crawlerów AI?

- Jakie znaczenie dla AI crawlability mają dane strukturalne Schema?

- Czemu warto monitorować logi serwera pod kątem wizyt GPTBot, ClaudeBot lub PerplexityBot?

Czym jest AI crawlability i czym różni się od tradycyjnego SEO?

W klasycznym europejskim SEO crawlability było rozpatrywane właściwie tylko pod kątem Googlebota. W erze AI search obsłużony musi być każdy z kilkunastu aktywnych crawlerów AI. Twoja strona powinna umożliwiać swobodne odwiedzanie i odczytanie oraz poprawną interpretację treści. Jeśli te warunki nie zostaną spełnione, szanse na cytowanie Twojego contentu spadną.

Różnicę widać również w diagnostyce i optymalizacji. W tradycyjnym SEO do dyspozycji masz wiele narzędzi - w tym Google Search Console, logi serwera i znane reguły robots.txt. Optymalizacja pod kątem AI search wciąż się rozwija. Nie ma jednego konkretnego narzędzia do weryfikacji crawlability ani funkcji ręcznego zgłaszania stron do ponownego crawlowania. Ekosystem botów zmienia się też z miesiąca na miesiąc (https://www.conductor.com/academy/ai-crawlability/).

Pamiętaj jednak, że nowe technologie nie zastępują starych zasad. Wciąż należy więc zadbać o fundamenty SEO. Sprawdź nasz artykuł: Pozycjonowanie w pytaniach i odpowiedziach — największe FAQ o SEO

Przeanalizowaliśmy setki stron pod kątem czytelności dla modeli językowych i jeden błąd techniczny powtarza się niemal wszędzie. Może Was to zdziwić, ale Crawlability w kontekście AI to dzisiaj znacznie więcej niż tylko plik robots.txt czy dostępność serwera. Ciekawe, czy zdajecie sobie sprawę, że istnieje jeden bardzo częsty i mało omawiany błąd techniczny, który sprawia, że AI nie widzi kluczowych informacji o firmie. Choć dla użytkownika są one doskonale widoczne na stronie, dla algorytmów pozostają ukryte. Chodzi o dane ukryte w grafikach oraz animowanych licznikach JavaScript. Założę się, że część z Was nawet nie pomyśli, że Wasze największe atuty są dla maszyn nieczytelne. Wiele firm prezentuje swoje wyróżniki, takie jak liczba lat na rynku, liczba obsłużonych klientów czy zrealizowanych projektów, w formie atrakcyjnych grafik lub liczników, które startują od zera i odliczają w górę. Dla użytkownika wygląda to świetnie, ale dla AI to po prostu nie istnieje. Pamiętajcie, że AI nie czyta treści z obrazków i nie uruchamia JavaScriptu tylko po to, żeby zobaczyć końcową wartość Waszego licznika. Może Was to zaskoczyć, ale każdy z Was może zrobić prosty test. Wrzuć swoją stronę O nas do ChatGPT i zapytaj, ile lat ta firma jest na rynku lub ilu klientów obsłużyła. Jeśli AI odpowie, że nie wie, to znaczy, że te informacje są na stronie całkowicie nieczytelne dla modeli AI. To ogromny problem, bo jeśli AI nie widzi Twoich wyróżników, to nie może ich zacytować w odpowiedzi, kiedy ktoś zapyta, jaką firmę polecasz w branży X. Rozwiązanie jest jednak banalnie proste. Wyróżniki Twojej oferty muszą być zapisane w formie tekstowej HTML, a nie tylko w grafice czy animacji. Możesz bez problemu zachować ładne liczniki dla użytkownika, ale obok nich musi znaleźć się warstwa tekstowa, którą AI jest w stanie bez trudu odczytać. To jest prawdziwy nisko wiszący owoc, ponieważ cała zmiana trwa zaledwie godzinę, a efekt w widoczności dla algorytmów może być natychmiastowy. Ekspert agencji widoczni w SEO i SEO AI z wieloletnim doświadczeniem. Przeszkolił z zakresu optymalizacji stron w Google dziesiątki specjalistów. Prowadzi regularnie szkolenia i webinary dla biznesu na temat SEO AI.Okiem eksperta widoczni:

Jak sprawdzić i poprawić AI crawlability?

Niewidzialne sukcesy Twojej firmy

Wykonaj prosty test i sprawdź prawdę

Nisko wiszący owoc naprawisz w godzinę

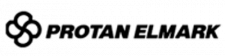

Jak działają crawlery AI? Najważniejsze różnice w porównaniu z Googlebotem

Żeby skutecznie optymalizować stronę pod AI crawlability, musisz rozumieć, że crawlery AI działają inaczej niż Googlebot.

Brak obsługi JavaScript

Najważniejsza różnica techniczna między Googlebotem a crawlerami AI dotyczy obsługi JavaScript. Googlebot renderuje skrypty, ale zwykle robi to powoli. Większość crawlerów AI - w tym GPTBot, ClaudeBot czy PerplexityBot - nie renderuje JavaScriptu. Zwykle widzą więc wyłącznie surowy HTML zwrócony przez serwer w momencie zapytania.

Jeśli opisy produktów, recenzje czy sekcje FAQ ładują się przez JS, dla crawlerów AI te fragmenty nie istnieją i nie zostaną zaindeksowane ani zacytowane. Najważniejsze treści muszą więc być publikowane w surowym HTML. To, jak renderowana jest treść strony, możesz sprawdzić w jej kodzie źródłowym - po prostu otwórz ją i użyj skrótu Ctrl+U.

Przeczytaj też nasz poradnik: Co powinieneś wiedzieć o JavaScript SEO?

Wyższa częstotliwość crawlowania

Boty AI odwiedzają strony znacznie częściej niż tradycyjne wyszukiwarki. W badaniu Conductora w ciągu 5 dni od publikacji ChatGPT odwiedził stronę około 8 razy częściej niż Google, a Perplexity - około 3 razy częściej (https://www.conductor.com/academy/ai-crawlability/). Nowa treść może zatem trafić do AI search już w dniu publikacji.

Brak narzędzia do ręcznego zgłaszania stron

W tradycyjnym SEO możesz poprosić Google o ponowne zaindeksowanie przez Search Console. W przypadku botów AI takiej opcji nie ma. Jeśli crawler natrafi na problemy, częstotliwość odwiedzin spadnie, a to utrudni zmianę oceny. Twoja strona powinna zatem być dopracowana technicznie i merytorycznie od chwili publikacji.

Czym różnią się boty AI do Googlebota?

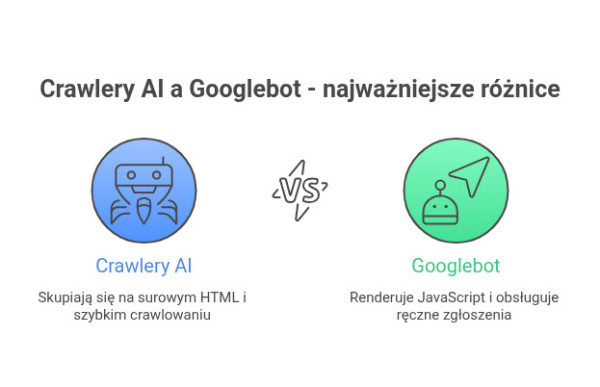

Jakie boty AI odwiedzają Twoją stronę? Przegląd kluczowych crawlerów

Żeby boty AI mogły odwiedzać Twoją stronę, potrzebujesz odpowiedniej zoptymalizacji. To zaś wymaga wiedzy o nazwach i działaniu poszczególnych crawlerów. W swojej strategii uwzględnij przede wszystkim:

Crawlability a boty OpenAI

OpenAI operuje trzema (https://platform.openai.com/docs/bots) crawlerami o różnych funkcjach:

- GPTBot - zbiera dane do trenowania modeli AI. Między majem 2024 a majem 2025 jego ruch wzrósł o 305% (https://www.playwire.com/blog/how-to-block-ai-bots-with-robotstxt-the-complete-publishers-guide). Zablokowanie go nie wpływa na cytowanie strony przez ChatGPT.

- OAI-SearchBot - buduje indeks ChatGPT Search. Zablokowanie może ograniczyć pobieranie stron na żądanie użytkownika, ale nie jest to pewne. Skuteczniejsze okazują się reguły po stronie serwera, np. blokada UA, WAF, autoryzacja.

- ChatGPT-User - uruchamiany wyłącznie na żądanie użytkownika. Zablokowanie uniemożliwia ChatGPT cytowanie i linkowanie do Twojej strony w rozmowach.

Anthropic - ClaudeBot i pochodne

Anthropic używa kilku user-agentów: ClaudeBot (główny crawler i treningi), Claude-SearchBot (zbieranie i przetwarzanie informacji z sieci) i Claude-User (wyszukiwanie na żądanie użytkownika). Firma udostępnia dokumentację i instrukcje blokowania (https://support.anthropic.com/en/articles/8896518-does-anthropic-crawl-data-from-the-web-and-how-can-site-owners-block-the-crawler).

Jakie boty Perplexity wchodzą na Twoją stronę?

PerplexityBot (PerplexityBot/1.0) indeksuje treści dla AI search i według deklaracji firmy nie jest używany do trenowania własnych modeli (Perplexity korzysta z modeli OpenAI i Meta) (https://scrunch.com/resources/guides/guide-to-ai-user-agents/). Obok niego działa Perplexity-User, uruchamiany, gdy użytkownik kliknie w cytowane źródło.

W sierpniu 2025 roku Cloudflare opisało przypadki modyfikacji user-agent i zmiany adresów IP przez Perplexity. Narzędzie mogło w ten sposób ominąć blokady ustawione w robots.txt. Cloudflare usunęło wówczas Perplexity z listy zweryfikowanych botów (https://blog.cloudflare.com/perplexity-is-using-stealth-undeclared-crawlers-to-evade-website-no-crawl-directives/). To ważny sygnał - robots.txt to norma, ale nie zawsze jest respektowana.

Więcej o Perplexity dowiesz się z naszego artykułu: Perplexity AI. Potęga wyszukiwania za pomocą sztucznej inteligencji

Google-Extended - osobny token dla Gemini

Google-Extended to specjalny token w robots.txt pozwalający zablokować używanie Twoich treści do trenowania Gemini i Vertex AI. Co ważne, zablokowanie Google-Extended nie wpływa na rankingi w tradycyjnym wyszukiwaniu Google (https://www.stanventures.com/news/google-to-publishers-blocking-ai-crawlers-wont-affect-your-search-rankings-2542/). Pamiętaj jednak, że w przypadku AI Overviews Google może korzystać z treści wydawców, którzy ustawili Google-Extended Disallow - blokada treningu nie gwarantuje zatem pominięcia w AI Overviews (https://www.niemanlab.org/2025/05/google-is-using-content-from-publishers-who-opt-out-of-other-ai-training-to-power-ai-overviews/).

Pozostałe crawlery ważne w AI search

Ekosystem botów AI jest znacznie szerszy. Cloudflare zidentyfikowało łącznie ponad 226 crawlerów powiązanych z platformami AI (https://momenticmarketing.com/blog/ai-search-crawlers-bots). Wśród nich są m.in. Applebot-Extended (opt-out z trenowania Apple Intelligence), meta-externalagent (Meta/Llama), GrokBot i Grok-DeepSearch (xAI) oraz Amazonbot (Amazon/Alexa).

Najważniejsze boty AI

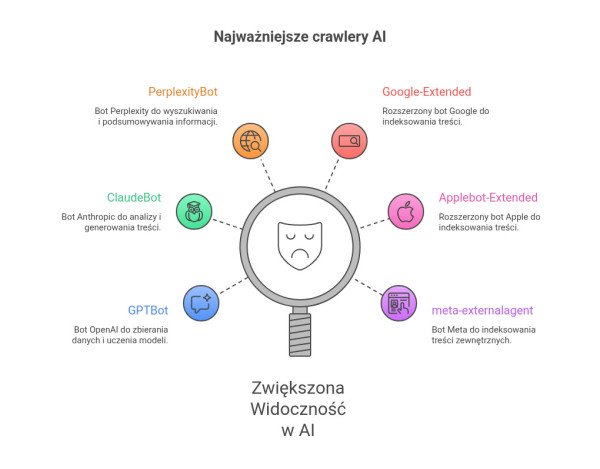

Co blokuje crawlery AI? Najważniejsze przeszkody

Kilka technicznych błędów może sprawić, że Twoja strona będzie pomijana w AI search - i to bez względu na jakość treści. By poprawić widoczność dla botów AI unikaj tych błędów:

Nadmierne poleganie na JavaScript

Jeśli najważniejsze elementy strony ładowane są przez JS, boty AI ich nie widzą. Problem dotyczy zwłaszcza sklepów i stron opartych na frameworkach React/Vue/Angular bez SSR. Jak już powiedzieliśmy, treści, które mają być cytowane, muszą być umieszczone w surowym HTML.

Brak danych strukturalnych

Bez danych strukturalnych Schema.org bot AI musi zgadywać, kto jest autorem, kiedy treść była opublikowana i czego dotyczy. Brak tych znaczników może więc niekorzystnie wpłynąć na jakość indeksowania i obniżyć szanse na cytowania Twoich treści (https://www.conductor.com/academy/ai-crawlability/). Przeczytaj nasz poradnik o danych strukturalnych.

Błędy techniczne i słaba wydajność

Powolne ładowanie, uszkodzone linki 404, błędy serwera i inne problemy techniczne obniżają ocenę strony przez crawlery AI tak samo jak przez Google. Serwis z problemami technicznymi jest rzadziej odwiedzany i cytowany (https://www.conductor.com/academy/ai-crawlability/). Jak tego uniknąć? Technicznie zoptymalizuj stronę pod kątem SEO AI.

Treści za bramką

Marki do tej pory zarabiające na treściach premium i chowające je za paywallem stają dziś przed dylematem. Otworzyć płatne zasoby na crawlery AI, by budować autorytet, czy chronić jak wcześniej? Na to pytanie nie ma jednej odpowiedzi, a wszystko zależy od Twojej strategii i przyjętych priorytetów. Coraz więcej firm eksperymentuje z hybrydowym podejściem i staranniejszą selekcją contentu, za który użytkownik będzie musiał zapłacić.

Czynniki niekorzystnie wpływające na crawlability

Jak kontrolować dostęp crawlerów AI do Twojej strony? robots.txt w praktyce

Plik robots.txt to pierwsza i najważniejsza linia kontroli dostępu crawlerów AI. Należy skonfigurować go świadomie. Domyślne ustawienia oznaczają zezwolenie na wszystko, a to nie zawsze jest korzystne dla Twojej marki.

Dwa typy botów AI - dwie różne strategie

Przed edycją robots.txt musisz pamiętać, że istnieją dwie różne kategorie botów AI:

- Crawlery treningowe (GPTBot, anthropic-ai, Google-Extended, CCBot) - wbudowują Twoje treści w wiedzę modelu. Dla Ciebie nie przekłada się to na zwiększenie ruchu ani atrybucji.

- Crawlery cytujące (OAI-SearchBot, ChatGPT-User, PerplexityBot) - pobierają treści w czasie rzeczywistym i linkują do Twojej strony, a to realny ruch i widoczność.

Coraz więcej wydawców blokuje crawlery treningowe, zezwalając jednocześnie na crawlery cytujące (https://scrunch.com/resources/guides/guide-to-ai-user-agents/). Przy podejmowaniu decyzji warto uwzględnić potencjalne korzyści. Dane Cloudflare z 2025 roku pokazują, że wskaźnik crawl-to-referral Anthropica wynosił 73 000:1 (73 000 odwiedzonych stron na jedno odesłane kliknięcie), podczas gdy Google Search osiągał 14:1 (https://blog.cloudflare.com/control-content-use-for-ai-training/).

Najważniejsze typy crawlerów AI

Przykładowa konfiguracja robots.txt

Poniżej prezentujemy przykład pliku robots.txt realizującego strategię blokowania treningów, ale zezwolenia na cytowanie:

# OpenAI

User-agent: GPTBot

Disallow: /

User-agent: OAI-SearchBot

Allow: /

User-agent: ChatGPT-User

Allow: /

# Anthropic

User-agent: anthropic-ai

Disallow: /

User-agent: ClaudeBot

Allow: /

# Perplexity

User-agent: PerplexityBot

Allow: /

User-agent: Perplexity-User

Allow: /

# Google

User-agent: Google-Extended

Disallow: /

# Apple

User-agent: Applebot-Extended

Disallow: /

# Tradycyjne wyszukiwarki - bez zmian

User-agent: Googlebot

Allow: /

User-agent: Bingbot

Allow: /

Pamiętaj, że zmiany są uwzględniane przez systemy OpenAI z opóźnieniem do 24 godzin (https://help.openai.com/en/articles/12627856-publishers-and-developers-faq). Zablokowanie OAI-SearchBota może też nie wystarczyć, bo zdarza się, że OpenAI wyświetla tytuł i URL z zewnętrznych źródeł - np. Bing. Jeśli chcesz ograniczyć indeksowanie, rozważ użycie meta tagu robots z dyrektywą noindex (https://help.openai.com/en/articles/12627856-publishers-and-developers-faq).

Znaczenie pliku robots.txt nie maleje w erze SEO AI. To dowód na to, że fundamenty tradycyjnego SEO nadal są ważne. Sprawdź inne artykuły na ten temat:

- Jak SEO AI zmienia pozycjonowanie stron?

- SEO w Google czy SEO w AI - co działa w 2025 roku?

- Jak działa SEO w AI Search?

Ograniczenia robots.txt a boty AI

Robots.txt działa na zasadzie dobrej woli. Jak pokazał przypadek Perplexity, zdarza się, że boty go ignorują. Jeśli zależy Ci na twardej blokadzie, potrzebujesz dodatkowych zabezpieczeń - np. blokowania po IP lub Cloudflare Bot Management.

Dane Schema - jak wpływają na widoczność dla botów AI?

Dane strukturalne w formie znaczników opracowanych przez Schema pozwalają Ci opisać i przetłumaczyć swoje treści na język zrozumiały dla modeli językowych.

Które znaczniki Schema są najważniejsze?

W kontekście widoczności dla botów AI największe znaczenie mają następujące znaczniki Schema:

- Article - obowiązkowo umieszczaj go w każdym artykule i poście blogowym. Definiuje datę publikacji, datę ostatniej aktualizacji, autora i tematykę treści.

- Author - sygnał eksperckiego charakteru treści i autorytetu. LLM-y przypisują większą wiarygodność treściom, za którymi stoją konkretni, zidentyfikowani eksperci z udokumentowanym dorobkiem. Efekt wzmacnia powiązanie strony autora z profilem w Wikipedii, Google Scholar lub LinkedIn.

- FAQ - strukturyzuje sekcje pytań i odpowiedzi. AI szczególnie chętnie cytuje właśnie tego typu treści, ponieważ są gotowymi, zwięzłymi odpowiedziami na konkretne pytania.

- Product - niezbędny w e-commerce. Definiuje nazwę produktu, opis, cenę, dostępność, recenzje. Jeśli zależy Ci na obecności w odpowiedziach AI na zapytania zakupowe, poprawne dane Schema Product to absolutny must-have.

- Organization - pomaga AI zidentyfikować Twoją markę, jej branżę, dane kontaktowe i powiązane zasoby online.

Strony bez znaczników Schema wymagają od crawlerów AI znacznie więcej interpretacji własnej - a to zwiększa ryzyko błędnego zrozumienia treści i obniża szansę na cytowanie.

Jak zweryfikować poprawność znaczników Schema?

Aby upewnić się, że poprawnie wdrożyłeś znaczniki Schema, użyj Google Rich Results Test (https://search.google.com/test/rich-results) lub Schema Markup Validator (https://validator.schema.org/).

Czym jest llms.txt i czy naprawdę go potrzebujesz?

W dyskusjach o AI crawlability pojawia się też llms.txt, czyli plik Markdown w katalogu głównym domeny wskazujący modelom językowym najważniejsze zasoby serwisu.

Czym różni się llms.txt od robots.txt?

Plik robots.txt to zestaw dyrektyw, które boty - przynajmniej formalnie - muszą respektować i w większości przypadków tak się dzieje. Plik llms.txt to wyłącznie plik pomocniczy - nie blokuje, nie zezwala ani nie wydaje nakazów. Zarządzanie dostępem wciąż odbywa się na poziomie robots.txt.

Czy plik llms.txt wpływa na to, jak boty AI widzą stronę?

Żadna z głównych platform AI nie ogłosiła oficjalnie, że korzysta z llms.txt. Nie opublikowano też żadnych zweryfikowanych danych empirycznie potwierdzających, że plik ten poprawia widoczność w AI search. John Mueller z Google wielokrotnie komentował, że llms.txt jest zbędny z punktu widzenia tradycyjnego SEO (https://www.searchenginejournal.com/llms-txt-for-ai-seo/556576/). Mimo to plik umieściły już setki serwisów - w tym Anthropic, Perplexity, Stripe, Cloudflare i Zapier (https://peec.ai/blog/llms-txt-md-files-important-ai-visibility-helper-or-hoax). Jeśli jednak zdecydujesz się na jego wdrożenie, potraktuj to tylko jako opcjonalne uzupełnienie.

Pamiętaj też, że tworzenie plików .md z kopiami każdego artykułu i linkowanie ich z llms.txt może generować duplicate content i zaszkodzić tradycyjnemu SEO, a przez to pośrednio też widoczności w AI search (https://gofishdigital.com/blog/llm-seo/). Ogranicz więc tę praktykę do wskazania najważniejszych zasobów i nie powielaj całej treści serwisu.

Sprawdź nasze pozostałe artykuły o budowaniu widoczności w AI search:

Core Web Vitals i wydajność strony w kontekście AI crawlability

Szybkość i stabilność strony to nie tylko czynnik rankingowy w Google. To też sygnał wpływający na to, jak boty AI oceniają jakość serwisu. Strona z kiepskimi Core Web Vitals jest rzadziej odwiedzana i cytowana (https://www.conductor.com/academy/ai-crawlability/). Monitoruj więc przynajmniej trzy najważniejsze metryki:

- LCP (czas ładowania głównej treści, cel: poniżej 2,5 s),

- CLS (stabilność wizualna, cel: poniżej 0,1),

- INP (responsywność interfejsu, zastąpił FID od marca 2024).

Wolna, niestabilna strona to dla crawlera AI sygnał niskiej jakości technicznej - a to bezpośrednio obniża priorytet crawlowania.

Poznaj też 8 sposobów na poprawę strony pod kątem Core Web Vitals

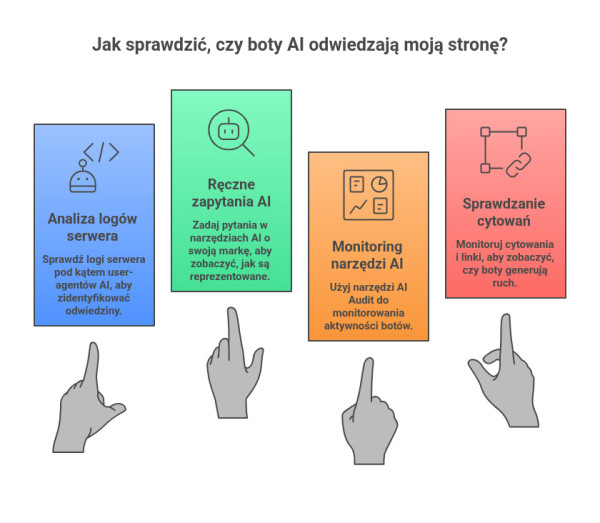

Czy boty AI mogą wejść na Twoją stronę? Jak to sprawdzić?

Nie możesz optymalizować tego, czego nie mierzysz. Chcąc zadbać o to, by boty AI mogły wejść na Twoją stronę, musisz więc wdrożyć odpowiedni system monitoringu widoczności w AI search.

Logi serwera a widoczność w AI search

Sprawdzanie logów serwera to najprostsza i najbardziej dostępna metoda. W logach serwera wyszukaj user-agenty kluczowych crawlerów AI: GPTBot, OAI-SearchBot, ChatGPT-User, ClaudeBot, anthropic-ai, PerplexityBot, Google-Extended. Ich obecność potwierdza, że Twoja strona jest crawlowana. Brak takich logów może wskazywać np. na problemy techniczne.

Ręczna weryfikacja w platformach AI

Zapytaj ChatGPT, Claude lub Perplexity: „Czym zajmuje się firma X?" lub „Co oferuje marka X?". Odpowiedź oparta na Twojej stronie to dobry sygnał. Brak odpowiedzi, nieaktualne dane lub halucynacje mogą wskazywać na problemy z crawlability.

Dedykowane narzędzia do monitoringu AI crawlability

Coraz więcej platform oferuje dashboardy pokazujące aktywność crawlerów AI w czasie rzeczywistym. Są to np.:

- Conductor Monitoring,

- Profound,

- Cloudflare AI Audit.

Jak monitorować AI crawlability?

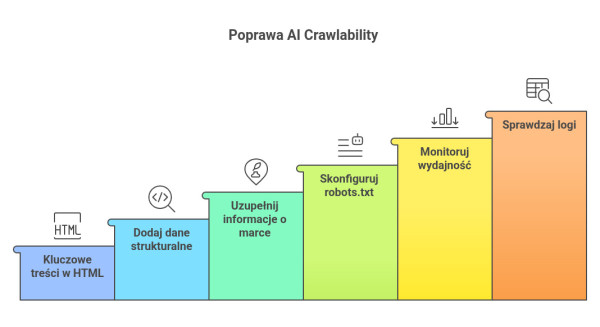

Jak poprawić widoczność strony dla botów AI? Checklista

Jeśli zastanawiasz się, co możesz zrobić, by poprawić widoczność swojej strony dla botów AI, skorzystaj z naszej checklisty:

- Sprawdź źródło strony (Ctrl+U) i sprawdź, czy kluczowe treści (opisy produktów, FAQ, główne informacje) są widoczne w surowym HTML, bez konieczności uruchamiania JavaScript.

- Dodaj lub popraw znaczniki Schema markup w artykułach (Article), biogramach autorów (Person), produktach (Product) i sekcjach FAQ.

- Uzupełnij informacje o autorze - każdy artykuł powinien mieć imienny podpis autora połączony ze stroną z biografią i linkami do profili zewnętrznych.

- Zaktualizuj robots.txt i upewnij się, że masz przemyślaną politykę dla każdego z głównych crawlerów AI. Nie pozostawiaj domyślnego zezwolenia na wszystko, jeśli nie jest to Twoja świadoma decyzja.

- Monitoruj Core Web Vitals w Google Search Console i napraw strony, które wypadają słabo.

- Sprawdź logi serwera pod kątem ruchu z GPTBot, ClaudeBot i PerplexityBot.

- Przeprowadź ręczny test w ChatGPT i Perplexity i sprawdź, czy AI poprawnie opisuje Twoją firmę i ofertę.

Jak poprawić AI crawlability?

AI crawlability jako fundament widoczności w nowej erze search. Podsumowanie

AI crawlability to konkretny, mierzalny aspekt widoczności w sieci. W dużym stopniu wpływa na to, czy Twoja marka będzie cytowana w odpowiedziach ChatGPT, Claude i Perplexity oraz czy pojawi się w Google AI Overviews. Dbając o dostęp botów AI do swojej strony, masz szansę kształtować te odpowiedzi na swoją korzyść. Jeśli to zaniedbasz, oddasz przestrzeń konkurentom.

FAQ

Oba typy ruchu możesz rozdzielić na podstawie user-agentów w logach. Jeśli widzisz wejścia botów typu “User" lub "SearchBot" i rośnie liczba wejść z poleceń (referral) z domen narzędzi AI, to masz sygnał, że crawl ma szansę przełożyć się na ekspozycję. Ruch botów treningowych biznesowo zwykle nie przynosi efektów. Potrafi być wysoki, ale nie buduje mierzalnych wejść ani leadów. Nie warto. To ryzykowne i łatwe do wykrycia jako cloaking. Lepsza strategia to dopracować jeden, spójny wariant, który jest czytelny bez JS, ma stabilne adresy URL i dobrze opisane elementy w danych strukturalnych. Zwykle zawodzi jedna z trzech rzeczy: treść renderowana dopiero po stronie klienta, skrypty zgody lub agresywne pop-upy blokujące treść oraz ukrycie contentu za paywallem Skup się na stabilnych URL-ach, tytułach, opisach i specyfikacjach kategorii. Ogranicz też indeksowalne kombinacje filtrów kategorii najważniejszych z biznesowego punktu widzenia. W kategoriach dodaj też sekcje poradnikowe - np. porównania, kryteria wyboru lub najczęstsze pytania klientów. To zwiększa szansę, że AI nie tylko zobaczy produkt, ale też poprawnie go opisze i porówna. Objawy to niespójne opisy oferty, mylenie kategorii, nieaktualne dane, albo przypisywanie Ci usług, których nie masz. Naprawa wymaga zwykle doprecyzowania informacji, spójnej nawigacji wewnątrz serwisu oraz dodania stron typu „Co robimy, a czego nie robimy” lub „Zakres usług”. Może, ale nie musi. Jeśli polegasz głównie na cytowaniach w czasie rzeczywistym, najważniejsze jest to, aby boty mogły wejść na stronę i pobrać treść na żądanie. Jeśli jednak Twoja strategia zakłada budowę długoterminowej rozpoznawalności w modelach, blokada treningu może ograniczyć ten efekt.Jak odróżnić ruch AI, który daje cytowania, od ruchu tylko do trenowania modeli?

Czy warto serwować botom AI inny wariant strony niż użytkownikom?

Jakie strony są najczęściej pomijane przez crawlery AI mimo dobrego SEO w Google?

Jak przygotować e-commerce pod AI cytowania przy dużej liczbie produktów i filtrów?

Jak mogę dowiedzieć się, że AI błędnie rozumie moją markę? Jak to naprawić?

Czy blokowanie treningu treści może zaszkodzić widoczności w AI odpowiedziach?

Poznaj historie sukcesów naszych klientów

Clutch.co to jedna z najbardziej wiarygodnych platform z opiniami na świecie!

Ponad 650 pozytywnych opinii w Google i 130 opinii na Clutch.co

Jesteśmy jedną z najlepiej i najczęściej ocenianych agencji marketingu internetowego w Polsce na największych platformach do ocen: Google i Clutch.co. Zobacz, nasze oceny i przekonaj się, że warto z nami współpracować.